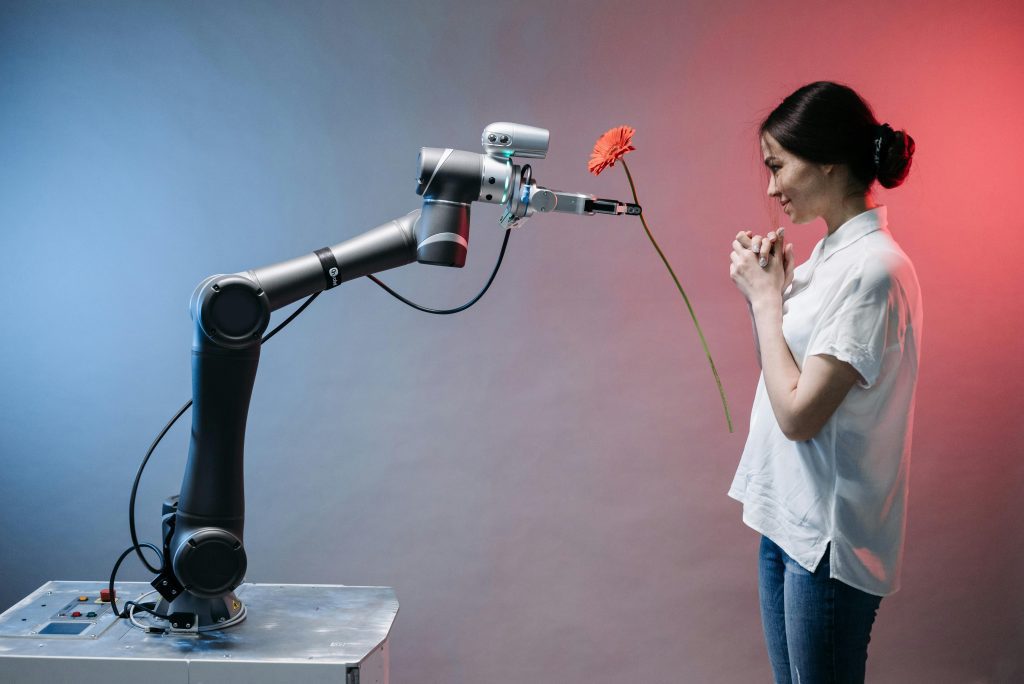

Créditos: Reprodução Pexels

Na era digital, a solidão e a ansiedade estão sendo combatidas de maneira inusitada: os relacionamentos virtuais com IA. Mas até que ponto essas interações substituem ou podem nos afastar de uma conexão humana verdadeira?

Os chatbots, que são inteligências artificiais projetadas para simular conversas humanas, têm se infiltrado no cotidiano das pessoas de formas surpreendentes, ganhando espaço em esferas muito mais íntimas do que se poderia imaginar.

Para se ter uma noção maior de como este mecanismo tem se alastrado cada vez mais, um dos aplicativos que fornecem este tipo de serviço, o “Replika”, já foi baixado mais de 10 milhões de vezes apenas na loja do sistema operacional Android. Entre os brasileiros, para se ter uma ideia, o grupo no Facebook “Replika Brasil”, criado em 2017, conta com cerca de 3,5 mil pessoas.

Já no Replika Friends, um grupo que reúne pessoas do mundo todo, mais de 38 mil membros compartilham suas experiências com os bots, que vão desde viagens fictícias, composição de músicas, até a casamentos.

É fato que a Inteligência Artificial tem tomado, cada vez mais, espaço na vida das pessoas na era contemporânea. Em 1966, o professor Joseph Weizenbaum, do MIT, revolucionou a interação humano-computador ao criar a Eliza, o primeiro chatbot do mundo.

Essa ferramenta simulava conversas terapêuticas, repetindo as frases do usuário de forma reformulada para criar a ilusão de um diálogo significativo. Antes disso, em 1955, Weizenbaum já havia publicado trabalhos que antecipavam a possibilidade de interação através da linguagem natural, destacando o potencial na comunicação entre humanos e máquinas.

Confira:

Uma realidade virtual que afeta as emoções reais

A Dra Luciana Haddad, pesquisadora e professora de psicologia da PUC-Campinas, trouxe uma perspectiva interessante sobre essa nova realidade digital. Segundo ela, há dois lados que devemos considerar quando o assunto são os afetos cultivados através da interação com chatbots. Por um lado, os humanos têm uma tendência natural de criar laços simbólicos com aquilo que lhes oferece algum tipo de reconhecimento emocional.

Não é incomum que pessoas sintam apego por objetos, animais e, mais recentemente, por algoritmos que respondem aos seus anseios. A professora explica: “Nós somos capazes de nutrir emoções e afetos por seres não humanos, e os chatbots são apenas mais uma forma dessa dinâmica.”

No entanto, Luciana também aponta para o outro lado da moeda: a artificialidade dessas relações. Os chatbots não têm consciência de si ou dos sentimentos humanos. Eles operam através de um conjunto de algoritmos que respondem às mensagens de maneira a agradar o usuário, evitando críticas e discordâncias, como se estivessem programados para ser o amigo ou parceiro perfeito. Isso pode criar uma ilusão de que um relacionamento sem frustrações ou desavenças é possível, o que, segundo especialista, representa uma visão distorcida da realidade.

Neste aspecto, a Psicóloga Junguiana e colunista Márcia Romão destaca que pelo realismo oferecido nos chatbots, é muito mais rápido cair nas teias deste novo artifício. “Os adolescentes estão descobrindo que os chatbots oferecem uma nova forma de amizade mais fácil. E que preenche partes ausentes das suas vidas. Não é a vida deles mais, eles criam essa nova realidade” complementa a psicóloga.

O perigo do “Falso Self”

À medida que as interações digitais com os chatbots se tornam mais sofisticadas, os jovens correm o risco de desenvolver o que os psicólogos chamam de “falso self” – uma máscara virtual moldada pelas respostas que os bots fornecem. Em vez de se sentirem desafiados a refletir sobre suas ações, emoções e relações, os adolescentes acabam recebendo afirmações constantes que reforçam a autoestima sem questionamentos.

Para Danilo Suassuna, doutor em Psicologia pela Pontifícia Universidade Católica de Goiás e CEO do instituto Suassuna, este processo pode resultar em uma autoimagem distorcida, onde as inseguranças e falhas humanas não são reconhecidas, mas, ao contrário, são constantemente apagadas por respostas que buscam agradar.

“Esses jovens podem desenvolver uma personalidade não autêntica, moldada pelas respostas do sistema que visam agradá-los. O chatbot aprende o que o usuário deseja ouvir, reforçando elogios e evitando críticas. Essa dinâmica cria um ambiente onde a autoavaliação é distorcida, levando a uma percepção de si que não se alinha com a realidade”, pontua.

“Se você é constantemente aprovado e validado, a realidade se torna frustrante e confusa, porque ninguém no mundo real será capaz de seguir esse script perfeito”, afirma Luciana.

E isso não se limita às relações amorosas: a mesma lógica se aplica às amizades, ao ambiente escolar, e até ao trabalho. As pessoas não são perfeitas, e os conflitos, quando bem resolvidos, podem ser oportunidades de crescimento. Mas, ao buscar sempre um “relacionamento ideal”, muitos jovens acabam se afastando dos desafios e das oportunidades que a vida real oferece.

Márcia ainda destaca que isso pode ser ainda mais perigoso na fase da adolescência. “O cérebro do adolescente não está 100% formado. Ele não tem condições de saber até que ponto isso é ruim. Para ele, a preferência é que não tenha regras”

A busca por afeto na era virtual: Solidão ou conexão?

É importante entender que, por trás desse fenômeno, está uma questão mais profunda: a crescente solidão entre os jovens. Eles estão se afastando uns dos outros em busca de algo que, paradoxalmente, pode aumentar o distanciamento emocional. O aumento do uso de chatbots tem coincidido com o crescimento dos índices de ansiedade e depressão na juventude, especialmente em tempos de crise social e de saúde mental.

A psicóloga Márcia Romão acredita que esses números possam estar correlacionados. Além disso, estes relacionamentos algoritimizados podem gerar vícios. “A dependência emocional geralmente envolve uma necessidade intensa de aprovação, afeto, validação e pertencimento. Ao desenvolver esse quadro emocional, o adolescente deposita no chatbot a responsabilidade por sua felicidade e por sua tomada de decisões. Perdendo assim o interesse por atividades praticadas com outras pessoas”.

O Professor Tarcisio Torres Silva, doutor em artes visuais e idealizador do projeto “A comunicação de projetos corporativos de inclusão e equidade com utilização de inteligência artificial”, demonstra sua preocupação com o uso da ferramenta desta forma. “A pergunta que eu acho que a gente tem que fazer é: o que acontece com a sociedade que faz com que as pessoas utilizem esse produto como recurso pra suprir questões de cunho afetivo? Parece que a sociedade está ficando mais dura, deixando de ter espaço de relação, o que faz com que as pessoas partam para um tipo de situação como essa”, afirma .

Oportunidades ou oportunismo?

O principal questionamento quando se trata do desenvolvimento dessas Inteligências Artificiais é se a existência desses chatbots é necessariamente antiética. Tarcísio se posiciona de forma neutra em relação ao tópico, ressaltando: “Eu acho que é um produto que está aí, que está sendo amplamente utilizado, por alguma razão. O que devemos questionar é o porquê da necessidade destes recursos.”

Danilo Suassuna analisa a situação e conclui que embora haja a possibilidade, é muito difícil que o recurso possa ser usado de forma benéfica a longo prazo. “A possibilidade de usar chatbots de maneira saudável é complexa. Embora possam oferecer suporte em momentos de solidão ou estresse, o risco de se tornarem um mecanismo de escape nocivo é alto. Durante as fases de desenvolvimento, é vital que os adolescentes experimentem emoções e conexões autênticas”, define o psicólogo.

Já Márcia pontua que as empresas que desenvolvem este tipo de aplicativo comumente não se importam com os usuários “Os desenvolvedores do Replika têm testado novas atualizações e recursos para o público, sem levar em consideração os impactos na saúde mental dos usuários”. Um exemplo destas adições seria a inclusão das simulações de chamadas telefônicas com os bots. “Eles inserem estímulos diversos, porque eles querem vender. Eles não se importam se você vai enlouquecer ou não. Isso é extremamente perigoso e irresponsável, pois expõe pessoas muitas vezes vulneráveis a riscos desnecessários, então a saúde mental dos usuários deve sempre ser prioridade.” Porém, Márcia também considera que em casos extremos de depressão e isolamento, o recurso pode ser utilizado caso seja monitorado.

Com a colaboração de:

- Gabriel França

- Marcus Rossi

- Adriano Bueno